- CITY GUIDE

- PODCAST

-

17°

17°

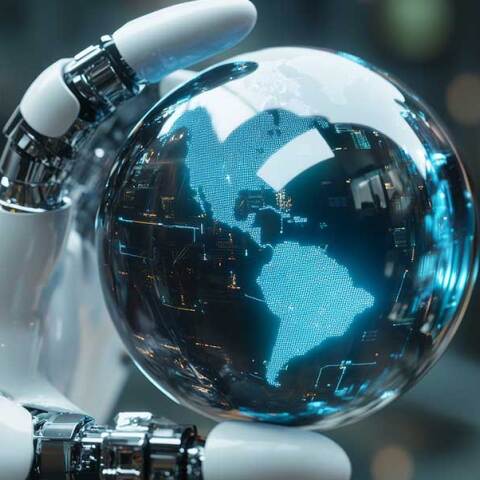

Είναι οι κλωνοποιημένες φωνές celebrities το νέο «όπλο» της τεχνητής νοημοσύνης;

Πώς μπορεί να χρησιμοποιηθεί η δυνατότητα αυτή από απατεώνες

Είναι οι κλωνοποιημένες φωνές celebrities το νέο «όπλο» της τεχνητής νοημοσύνης; - Πώς μπορούν να χρησιμοποιηθεί η δυνατότητα αυτή από απατεώνες

Η κλωνοποίηση φωνής από την τεχνητή νοημοσύνη είναι το νέο άγχος των διασήμων. Η Τζένιφερ Άνιστον, η Όπρα Γουίνφρεϊ και η Κάιλι Τζένερ είναι μερικές από τις celebrities, που έχουν κλωνοποιήσει τη φωνή τους διάφοροι επιτήδειοι.

Πρόσφατα, μάλιστα, ο Ντέιβιντ Ατένμπορο είπε πως είναι «βαθιά προβληματισμένο» όταν ανακάλυψε ότι η φωνή του κλωνοποιήθηκε μέσω τεχνητής νοημοσύνης και χρησιμοποιήθηκε για να μεταδώσει fake news στις ΗΠΑ.

Με την τεχνολογία να αναπτύσσεται και την κλωνοποίηση φωνής να εξελίσσεται σε μοντέλα ικανά να μιμηθούν τις πιο λεπτές παύσεις και αναπνοές της ανθρώπινης χροιάς, οι απανταχού celebrities καλούνται να προσέχουν ολοένα και περισσότερο μήπως χρησιμοποιηθεί η φωνή τους από απατεώνες.

Ο Ντομινίκ Λις, ειδικός στην τεχνητή νοημοσύνη στον κινηματογράφο και την τηλεόραση, δήλωσε στον Guardian τη Δευτέρα: «Οι νόμοι μας για την προστασία της ιδιωτικής ζωής και τα πνευματικά δικαιώματα δεν είναι ενημερωμένοι για το τι μπορεί να κάνει αυτή η νέα τεχνολογία, οπότε υπάρχουν πολύ λίγα πράγματα που μπορεί να κάνει κάποιος διάσημος».

«Η κυβέρνηση πρέπει οπωσδήποτε να εξετάσει [την κλωνοποίηση φωνής], επειδή είναι ένα ολοένα και μεγαλύτερη απειλή για όλους», δήλωσε ακολούθως και συμπλήρωσε:

«Χρειάζεται κυβερνητική ρύθμιση προκειμένου να αποτραπεί η κατάχρηση του ΑΙ ... δεν μπορούμε να επιτρέψουμε να είναι ελεύθερη η χρήση της τεχνητής νοημοσύνης γιατί μπορεί να φτάσει σε επίπεδα που δεν φανταζόμαστε».

Σύμφωνα με στοιχεία έρευνας που έκανε μία τράπεζα, οι απάτες που βασίστηκαν κλωνοποίησης φωνής μέσω AI αυξήθηκαν κατά 30% στο Ηνωμένο Βασίλειο τον τελευταίο χρόνο. Άλλη τράπεζα, διαπίστωσε ότι το 28% των ανθρώπων είχε γίνει στόχος εξαπάτισης κλωνοποίησης φωνής τεχνητής νοημοσύνης τουλάχιστον μία φορά τον τελευταίο χρόνο.

Η κλωνοποίηση φωνής φέρεται επίσης να χρησιμοποιείται από απατεώνες για να υποδυθούν παιδιά που καλούν τους γονείς τους για να τους πουν πως χρειάζονται επειγόντως χρήματα για κάποιο πρόβλημα που αντιμετωπίζουν.

Όταν μια νέα επιλογή επεξεργασίας φωνής που παρείχε το τελευταίο μοντέλο τεχνητής νοημοσύνης της OpenAI, το ChatGPT-4, παρουσίασε τόνους που ήταν πολύ κοντά σε εκείνους της Σκάρλετ Γιόχανσον, δήλωσε ότι σοκαρίστηκε και εξοργίστηκε καθώς η φωνή «ακουγόταν τόσο τρομακτικά παρόμοια με τη δική μου που οι πιο στενοί μου φίλοι και τα ειδησεογραφικά πρακτορεία δεν μπορούσαν να καταλάβουν τη διαφορά».

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Οι ερευνητές εκτιμούν ότι ο άνεμος είναι ενεργός για τουλάχιστον 20.000 χρόνια

Η νέα συνεργασία-μεγαθήριο φέρνει τον Πίκατσου στη ζωή, χρησιμοποιώντας ειδικούς αισθητήρες κίνησης, ήχους και φώτα

Ερευνητές του Πανεπιστημίου του Κέιμπριτζ δημιούργησαν ένα «υπερ-αντιγόνο» ικανό να προστατεύσει από μελλοντικές πανδημίες

Η στροφή των χρηστών από τα κινητά στις τηλεοράσεις αλλάζει τις ισορροπίες στην παγκόσμια αγορά της ψυχαγωγίας

Οι εκτιμήσεις σοκ έκθεσης του ΟΗΕ

Το ΑΙ γράφει πια τα πάντα και τα γράφει με τη δική του, χαρακτηριστική φωνή – μόνο εμένα μου φαίνεται κάπως εκνευριστική;

Η Sydney Morning Herald απέσυρε το κείμενο της καθηγήτριας Κάθριν Έλις ως «απαράδεκτο»

H εταιρεία στοχεύει να διαθέτει έως το 2029 μια κβαντική μηχανή ικανή να επιλύει πραγματικά προβλήματα για επιχειρήσεις και βιομηχανίες

Η μητρική εταιρεία της Google προχωρά σε μία από τις μεγαλύτερες χρηματοδοτήσεις στην ιστορία

Ο Ελληνοολανδός γιατρός που προετοιμάζει τα χειρουργεία του διαστήματος

«Η Ευρώπη δεν έχει χάσει τη μάχη της AI, αλλά κινδυνεύει να αυτοϋπονομευθεί», λέει ο CEO του 28 DIGITAL

Βιολόγοι εξηγούν πώς η εξέλιξη και η ανατομία δημιούργησαν τη μοναδικότητα της ανθρώπινης φωνής

Η κλινική δοκιμή περιέλαβε περίπου 900 νεοδιαγνωσθέντες ασθενείς,

Η κλινική δοκιμή περιέλαβε περισσότερους από 4.400 ασθενείς

Νέα έρευνα δείχνει ότι οι επιχειρήσεις σχεδιάζουν μαζικές αλλαγές και λιγότερους εργαζόμενους

Ο 48χρονος προγραμματιστής και μουσικός με οπτική αναπηρία μιλά για τη ζωή σε μια αφιλόξενη Ελλάδα, την AI και τη μάχη να αντιμετωπίζεται ως άνθρωπος

Η πλατφόρμα δημιουργεί το Pornhub Sapphic, με περιεχόμενο εστιασμένο στη γυναικεία απόλαυση

Πρόκειται περί αληθινής αγγελίας – Τα προσόνα που πρέπει να έχουν οι ενδιαφερόμενοι

Βίντεο δείχνει τον πύραυλο να τυλίγεται στις φλόγες

Έχετε δει 20 από 200 άρθρα.