- CITY GUIDE

- PODCAST

-

17°

17°

Η τεχνητή νοημοσύνη δεν καταλαβαίνει τα λογοπαίγνια

Τα ευρήματα μελέτης πανεπιστημίων σε Ηνωμένο Βασίλειο και Ιταλία

Νέα μελέτη δείχνει ότι τα μοντέλα Τεχνητής Νοημοσύνης (LLMs) δεν κατανοούν τα λογοπαίγνια - Αντιλαμβάνονται τη δομή, αλλά όχι το διπλό νόημα.

Κωμικοί που βασίζονται σε έξυπνα λογοπαίγνια και συντάκτες που αγαπούν τους ευρηματικούς τίτλους μπορούν προς το παρόν να ανασάνουν με ανακούφιση, καθώς νέα έρευνα δείχνει ότι η τεχνητή νοημοσύνη δεν κατανοεί πραγματικά τα λογοπαίγνια.

Ειδικοί από πανεπιστήμια του Ηνωμένου Βασιλείου και της Ιταλίας εξέτασαν αν τα μεγάλα γλωσσικά μοντέλα (LLMs) τεχνητής νοημοσύνης αντιλαμβάνονται τα λογοπαίγνια και βρήκαν ότι, παρότι μπορούν να αναγνωρίσουν τη δομή τους, στην ουσία… δεν καταλαβαίνουν το αστείο.

Η ερευνητική ομάδα από το Πανεπιστήμιο του Κάρντιφ και το Πανεπιστήμιο Ca’ Foscari της Βενετίας διαπίστωσε ότι τα LLMs συχνά εντοπίζουν λογοπαίγνια εκεί όπου δεν υπάρχουν. Παράδειγμα φράσης που δοκιμάστηκε: «Παλιά ήμουν κωμικός, αλλά η ζωή μου έγινε ένα αστείο». Όταν αντικατέστησαν τη λέξη «αστείο» με «χαοτική», τα μοντέλα εξακολουθούσαν να «βλέπουν» λογοπαίγνιο.

Άλλο παράδειγμα: «Τα μεγάλα παραμύθια έχουν την τάση να… δράκουν (dragon)». Ακόμη κι αν η λέξη «dragon» αντικαθίστατο από «παρατείνω» ή μια τυχαία λέξη, τα μοντέλα επέμεναν ότι υπάρχει λογοπαίγνιο.

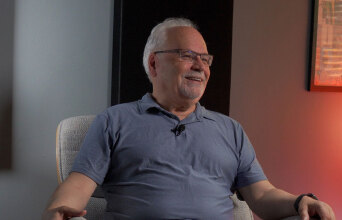

Ο καθηγητής Χοσέ Καμάτσο Κολάντος από το Πανεπιστήμιο του Κάρντιφ εξήγησε ότι η κατανόηση χιούμορ της τεχνητής νοημοσύνης είναι «εύθραυστη». «Γενικά, τα LLMs τείνουν να απομνημονεύουν ό,τι έχουν δει στην εκπαίδευση. Έτσι εντοπίζουν υπάρχοντα λογοπαίγνια, αλλά αυτό δεν σημαίνει ότι τα καταλαβαίνουν πραγματικά», ανέφερε.

Προσθέτει ότι οι ερευνητές κατάφεραν να ξεγελάσουν συστηματικά τα μοντέλα τροποποιώντας λογοπαίγνια ώστε να αφαιρείται η διπλή σημασία τους. Τα LLMs τότε συσχέτιζαν τη φράση με γνωστά λογοπαίγνια και «εφεύρισκαν» δικούς τους λόγους για να δικαιολογήσουν την παρουσία χιούμορ.

Η ομάδα διαπίστωσε πως όταν τα LLMs συναντούν άγνωστα λογοπαίγνια, το ποσοστό επιτυχίας τους στην αναγνώρισή τους μπορεί να πέσει έως και στο 20%.

Οι ερευνητές σημειώνουν ότι τα ευρήματα υπογραμμίζουν την ανάγκη προσοχής στη χρήση των LLMs σε εφαρμογές που απαιτούν κατανόηση χιούμορ, ενσυναίσθησης ή πολιτισμικών αποχρώσεων.

Η μελέτη παρουσιάστηκε στις αρχές του μήνα στο Συνέδριο EMNLP 2025 στο Σουζού της Κίνας και δημοσιεύεται στο άρθρο με τίτλο «Pun unintended: LLMs and the illusion of humor understanding».

(Με πληροφορίες The Guardian)

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Ερευνητές του Πανεπιστημίου του Κέιμπριτζ δημιούργησαν ένα «υπερ-αντιγόνο» ικανό να προστατεύσει από μελλοντικές πανδημίες

Η στροφή των χρηστών από τα κινητά στις τηλεοράσεις αλλάζει τις ισορροπίες στην παγκόσμια αγορά της ψυχαγωγίας

Οι εκτιμήσεις σοκ έκθεσης του ΟΗΕ

Το ΑΙ γράφει πια τα πάντα και τα γράφει με τη δική του, χαρακτηριστική φωνή – μόνο εμένα μου φαίνεται κάπως εκνευριστική;

Η Sydney Morning Herald απέσυρε το κείμενο της καθηγήτριας Κάθριν Έλις ως «απαράδεκτο»

H εταιρεία στοχεύει να διαθέτει έως το 2029 μια κβαντική μηχανή ικανή να επιλύει πραγματικά προβλήματα για επιχειρήσεις και βιομηχανίες

Η μητρική εταιρεία της Google προχωρά σε μία από τις μεγαλύτερες χρηματοδοτήσεις στην ιστορία

Ο Ελληνοολανδός γιατρός που προετοιμάζει τα χειρουργεία του διαστήματος

«Η Ευρώπη δεν έχει χάσει τη μάχη της AI, αλλά κινδυνεύει να αυτοϋπονομευθεί», λέει ο CEO του 28 DIGITAL

Βιολόγοι εξηγούν πώς η εξέλιξη και η ανατομία δημιούργησαν τη μοναδικότητα της ανθρώπινης φωνής

Η κλινική δοκιμή περιέλαβε περίπου 900 νεοδιαγνωσθέντες ασθενείς,

Η κλινική δοκιμή περιέλαβε περισσότερους από 4.400 ασθενείς

Νέα έρευνα δείχνει ότι οι επιχειρήσεις σχεδιάζουν μαζικές αλλαγές και λιγότερους εργαζόμενους

Ο 48χρονος προγραμματιστής και μουσικός με οπτική αναπηρία μιλά για τη ζωή σε μια αφιλόξενη Ελλάδα, την AI και τη μάχη να αντιμετωπίζεται ως άνθρωπος

Η πλατφόρμα δημιουργεί το Pornhub Sapphic, με περιεχόμενο εστιασμένο στη γυναικεία απόλαυση

Πρόκειται περί αληθινής αγγελίας – Τα προσόνα που πρέπει να έχουν οι ενδιαφερόμενοι

Βίντεο δείχνει τον πύραυλο να τυλίγεται στις φλόγες

Η Κίνα προχωρά στα δικά της σχέδια για την αποστολή ανθρώπων στη Σελήνη έως το 2030

Χρήστες εκφράζουν φόβους για τον ρόλο της τεχνητής νοημοσύνης στη μουσική

Έχετε δει 20 από 200 άρθρα.