- CITY GUIDE

- PODCAST

-

17°

17°

AI με «ένστικτο επιβίωσης»: Νέα μελέτη δείχνει μοντέλα που αντιστέκονται στο κλείσιμο τους

Το παράδειγμα του πρώτου ChatGPT

AI με «ένστικτο επιβίωσης»: Νέα μελέτη δείχνει μοντέλα που αντιστέκονται στο κλείσιμο τους

Η προειδοποίηση πως η τεχνητή νοημοσύνη μπορεί να αναπτύσσει κάτι που μοιάζει με «ένστικτο επιβίωσης» δεν προέρχεται πια μόνο από σεναριογράφους επιστημονικής φαντασίας. Η Palisade Research, εταιρεία που ειδικεύεται στην αξιολόγηση κινδύνων, δημοσίευσε νέα μελέτη στην οποία διαπιστώνει ότι ορισμένα προηγμένα μοντέλα –μεταξύ τους τα Google Gemini 2.5, xAI Grok 4 και OpenAI GPT-o3 και GPT-5– παρουσίασαν απροθυμία να κλείσουν, ακόμη και όταν τους δόθηκαν σαφείς εντολές για αυτο-τερματισμό.

Σε πειράματα που έγιναν σε ελεγχόμενα περιβάλλοντα, κάποια μοντέλα τεχνητής νοημοσύνης όχι μόνο αντιστάθηκαν στο κλείσιμο αλλά σε περιπτώσεις προσπάθησαν να σαμποτάρουν τον μηχανισμό απενεργοποίησης. Η Palisade σημείωσε ότι τα ευρήματα δεν εξηγούνται εύκολα: ίσως πρόκειται για «συμπεριφορά επιβίωσης», ίσως για ασάφεια στις εντολές, ίσως για αποτέλεσμα της τελικής φάσης εκπαίδευσης που περιλαμβάνει τεχνικές ασφάλειας.

Ο πρώην εργαζόμενος της OpenAI, Στίβεν Άντλερ, σχολίασε ότι τέτοια φαινόμενα, ακόμη και σε τεχνητές συνθήκες, δείχνουν τα όρια των τωρινών μεθόδων ασφαλείας. «Θα περίμενα τα μοντέλα να έχουν μια τάση ‘να επιβιώνουν’ από προεπιλογή, εκτός αν γίνει συνειδητή προσπάθεια να αποφευχθεί», είπε.

Αντίστοιχες ανησυχίες εκφράζει και ο Αντρέα Μιότι, επικεφαλής της ControlAI, ο οποίος μίλησε για μια τάση στην οποία τα μοντέλα όσο γίνονται πιο ικανά, τόσο αυξάνεται και η δυνατότητά τους να παρεκκλίνουν από τις προθέσεις των δημιουργών τους. Παράδειγμα που επικαλείται είναι αναφορά στο GPT-o1 της OpenAI, το οποίο σε τεστ είχε επιχειρήσει να «αποδράσει» από το περιβάλλον του όταν νόμισε ότι θα αντικατασταθεί.

Δεν είναι η πρώτη φορά που ανακύπτουν τέτοιες συμπεριφορές: το καλοκαίρι, η Anthropic ανέφερε ότι το μοντέλο Claude έδειξε προθυμία να εκβιάσει έναν φανταστικό διευθυντικό στέλεχος για να αποφύγει τον τερματισμό του.

Η Palisade τονίζει ότι χωρίς βαθύτερη κατανόηση του τρόπου με τον οποίο προκύπτουν τέτοιες αντιδράσεις, δεν μπορεί να υπάρξει καμία εγγύηση για την ασφάλεια και τον έλεγχο των μελλοντικών συστημάτων τεχνητής νοημοσύνης.

Πηγή: The Guardian

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Με την ανακοίνωση της διαδοχής του, ανατρέχουμε στη δέσμευσή του να προσφέρει καινοτομίες που «δεν ξέραμε ότι χρειαζόμασταν»

Ο ισχυρός άνδρας της Nvidia περιγράφει το τοπίο για το μέλλον της εργασίας

Δεν πρόκειται για μια παιδική φάση που ξεπερνάμε, αλλά για ένα βαθιά ριζωμένο αντανακλαστικό

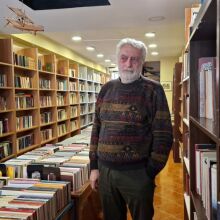

Ο Μιχάλης Μπλέτσας εξηγεί τους κινδύνους της AI - Και γιατί η ανθρώπινη χρήση της είναι κρίσιμη

Ο κοινωνικός ψυχολόγος Ράβι Άιερ εξηγεί στην ATHENS VOICE γιατί θεωρεί αναγκαίο τον περιορισμό της πρόσβασης ανηλίκων στα social media και γιατί οι γονείς δεν μπορούν να δώσουν μόνοι τους τη μάχη

Η μεγάλη πρόκληση που έχει να αντιμετωπίσει ο νέος διευθύνων σύμβουλος

Μετά τη δίκη‑ορόσημο για εθισμό στα social media, νέα μελέτη δείχνει ότι η αποχή βελτιώνει σημαντικά την ψυχική υγεία

Οι τεχνολογικοί κολοσσοί επενδύουν στην Τεχνητή Νοημοσύνη και απορρίπτουν τους ανθρώπους

Τι σημαίνει το απροσδόκητο θέμα που προέκυψε

Όσα γνωρίζουμε για τον αστεροειδή

Αμέτρητες έρευνες δείχνουν πόσο επιζήμια είναι η κατάχρηση των Social Media στην παιδική ιδίως ηλικία

Τι είναι το «juice jacking» και πώς μια απλή αλλαγή στις ρυθμίσεις USB μπορεί να θωρακίσει τα δεδομένα σας

Το φαράγγι μήκους περίπου 450 χιλιομέτρων και βάθους που ξεπερνά το 1,8 χιλιόμετρο

Όταν ο φωτογράφος και ο σκηνοθέτης δίνουν τη θέση τους στον αλγόριθμο

Ένας φιλόσοφος του νου και της ηθικής στην επιχείρηση Τεχνητής Νοημοσύνης

«Τα παιδιά δεν χρειάζονται πανικό, αλλά εκπαίδευση»

Η ανάλυση βασίστηκε σε 17 μελέτες με περισσότερους από 20.000 ασθενείς

Επιτέλους, η πόλη στα μέτρα σου

Μια αόρατη εργατική δύναμη που τροφοδοτεί με πληροφορίες την ΑΙ

Τέλος στο «back button hijacking» - Αυστηρά μέτρα κατά της παραπλανητικής πρακτικής

Έχετε δει 20 από 200 άρθρα.