- CITY GUIDE

- PODCAST

-

17°

17°

Όταν οι αλγόριθμοι ενισχύουν την προκατάληψη

Γιατί το δικαστικό σύστημα των ΗΠΑ στρέφεται ολοένα και περισσότερο σε εργαλεία τεχνητής νοημοσύνης και γιατί τα πράγματα δεν είναι απλά

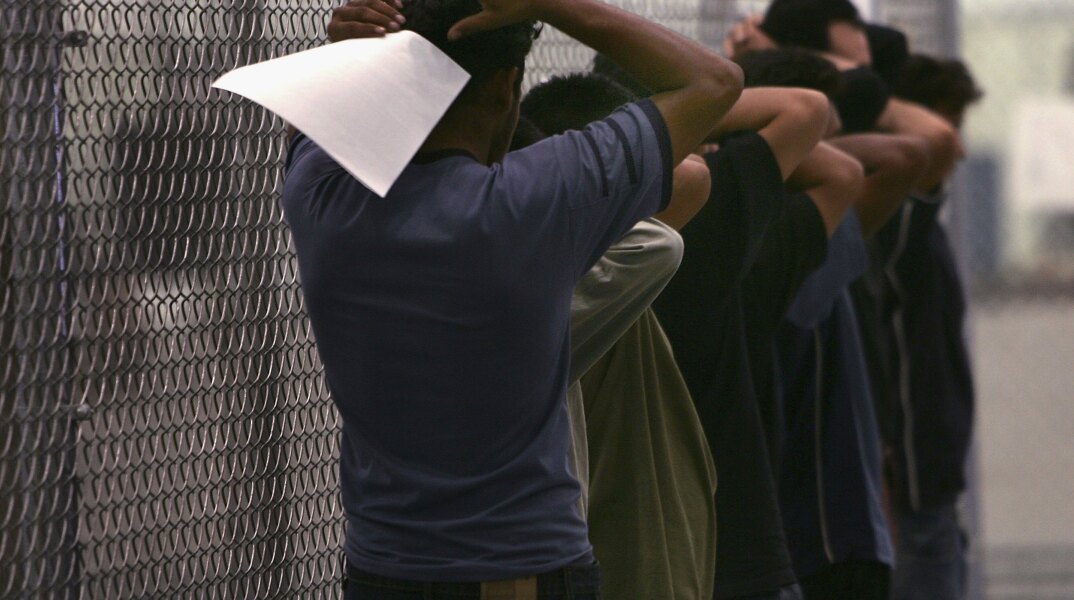

Στις ΗΠΑ φυλακίζονται περισσότεροι άνθρωποι από οποιαδήποτε άλλη χώρα στον κόσμο. Στο τέλος του 2016, περίπου 2,2 εκατομμύρια ενήλικες κρατούνταν σε φυλακές ενώ άλλα 4,5 εκατομμύρια βρίσκονταν σε άλλες σωφρονιστικές εγκαταστάσεις. Με άλλα λόγια, 1 στους 38 ενήλικες Αμερικανούς ήταν υπό κάποια μορφή εποπτείας. Η αναγκαιότητα για την αντιμετώπιση αυτής της εφιαλτικής κατάστασης είναι ένα από τα λίγα θέματα που ενώνει Δημοκρατικούς και Ρεπουμπλικάνους. Για αυτό το λόγο το δικαστικό σύστημα των ΗΠΑ στρέφεται ολοένα και περισσότερο τα τελευταία χρόνια σε εργαλεία αυτοματοποίησης και τεχνητής νοημοσύνης. Ο στόχος: θέλουν να πετύχουν τη μείωση των φυλακίσεων χωρίς να διακινδυνεύσουν όμως την αύξηση της εγκληματικότητας.

Έτσι τα αστυνομικά τμήματα χρησιμοποιούν αλγόριθμους πρόβλεψης για να σχεδιάζουν πού θα στέλνουν τις δυνάμεις τους. Άλλες υπηρεσίες επιβολής του νόμου χρησιμοποιούν συστήματα αναγνώρισης προσώπου για τον εντοπισμό υπόπτων. Αυτές οι πρακτικές έχουν συγκεντρώσει πολλές κριτικές για το εάν στην πραγματικότητα βελτιώνουν την ασφάλεια ή απλά διαιωνίζουν τις υφιστάμενες προκαταλήψεις. Διάφοροι ερευνητές και υπερασπιστές πολιτικών δικαιωμάτων, για παράδειγμα, έχουν επανειλημμένα αποδείξει ότι τα συστήματα αναγνώρισης προσώπου μπορεί να αποτυγχάνουν θεαματικά, ιδιαίτερα για άτομα με σκούρο δέρμα, μπερδεύοντας μέλη του Κογκρέσου με εγκληματίες.

Ωστόσο, το πιο αμφιλεγόμενο εργαλείο χρησιμοποιείται μετά από τη σύλληψη της αστυνομίας. Είναι οι αλγόριθμοι αξιολόγησης κινδύνου εγκληματιών. Αυτά τα εργαλεία εκτίμησης κινδύνου έχουν σχεδιαστεί για να κάνουν ένα πράγμα: παίρνουν ως είσοδο τις λεπτομέρειες του προφίλ του κατηγορουμένου και δίνουν ως έξοδο ένα αριθμό: την πιθανότητα υποτροπής, πόσο πιθανό είναι δηλαδή να επαναλάβει ο δράστης το έγκλημα. Αυτός ο αριθμός λαμβάνεται υπόψη σε πολλές αποφάσεις από τους δικαστές: από το αν θα πρέπει να υπάρξει προφυλάκιση πριν από τη δίκη και το είδος σωφρονισμού μέχρι το πόσο αυστηρές θα πρέπει να είναι οι ποινές τους. Η λογική είναι ότι αν μπορείς να προβλέψεις με ακρίβεια την εγκληματική συμπεριφορά, μπορείς να διαθέσεις με ακρίβεια τους πόρους, να μειώσεις την ανθρώπινη προκατάληψη και τον φόβο που επηρεάζει τη διαδικασία και εν τέλει να οδηγήσεις λιγότερους ανθρώπους στη φυλακή.

Στο συνέδριο Data for Black Lives που έγινε πριν από μια εβδομάδα περίπου στο πανεπιστήμιο ΜΙΤ φάνηκε ότι δυστυχώς τα πράγματα δεν είναι τόσο απλά. Τα εργαλεία αξιολόγησης κινδύνου βασίζονται σε ιστορικά δεδομένα για την εγκληματικότητα προκειμένου να κάνουν τη δουλειά τους. Οι αλγόριθμοι μηχανικής μάθησης που χρησιμοποιούν «διαβάζουν» τα στατιστικά στοιχεία για να βρουν επαναλαμβανόμενα μοτίβα και πρότυπα που σχετίζονται με το έγκλημα. Αλλά αυτά τα πρότυπα είναι στατιστικές συσχετίσεις, καμία σχέση με αιτίες. Εάν ένας αλγόριθμος βρίσκει, για παράδειγμα, ότι το πολύ χαμηλό εισόδημα συσχετίζεται με μεγάλη πιθανότητα εγκληματικότητας, αυτό δεν σημαίνει σε καμιά περίπτωση ότι το χαμηλό εισόδημα οδηγεί σε εγκλήματα. Αλλά αυτό ακριβώς κάνουν τα εργαλεία αξιολόγησης κινδύνου: μετατρέπουν συσχετιστικές γνώσεις σε μηχανισμούς αιτιώδους βαθμολόγησης. Έτσι οι κοινωνικές ομάδες που βρίσκονται από παλιά στο στόχαστρο των αρχών - ειδικά οι κοινότητες πολύ χαμηλού εισοδήματος και οι μειονότητες - κινδυνεύουν να βαθμολογηθούν με μεγάλη πιθανότητα εγκληματικής υποτροπής. Ως αποτέλεσμα, ο αλγόριθμος θα μπορούσε να ενισχύσει και να διαιωνίσει τις ενσωματωμένες προκαταλήψεις και να δημιουργήσει ακόμη περισσότερα «παραμορφωμένα» δεδομένα και να τροφοδοτήσει έναν φαύλο κύκλο.

Τον περασμένο Ιούλιο, περισσότερες από 100 οργανώσεις, συμπεριλαμβανομένης της Αμερικανικής Ένωσης για τις Πολιτικές Ελευθερίες (ACLU) και της Εθνικής Ένωσης για την Πρόοδο των Έγχρωμων Ατόμων (NAACP), υπέγραψαν δήλωση κατά της χρήσης των εργαλείων αξιολόγησης. Η αξιολόγηση μέσω αλγορίθμων είναι ένας εύκολος τρόπος κάθαρσης και νομιμοποίησης ενός καταπιεστικού και άνισου συστήματος, δήλωσε Marbre Stahly-Butts, διευθύντρια του Law for Black Lives, στο συνέδριο που φιλοξένησε το MIT. Αλλά αυτό είναι μόνο ένας τρόπος για να τραβήξουμε την προσοχή από τα πραγματικά προβλήματα που αντιμετωπίζουν φτωχοί και οι μειονότητες, όπως τα υποχρηματοδοτημένα σχολεία και η ανεπαρκής πρόσβαση στην υγειονομική περίθαλψη.

Με πληροφορίες από technologyreview.com

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Η στροφή των χρηστών από τα κινητά στις τηλεοράσεις αλλάζει τις ισορροπίες στην παγκόσμια αγορά της ψυχαγωγίας

Οι εκτιμήσεις σοκ έκθεσης του ΟΗΕ

Το ΑΙ γράφει πια τα πάντα και τα γράφει με τη δική του, χαρακτηριστική φωνή – μόνο εμένα μου φαίνεται κάπως εκνευριστική;

Η Sydney Morning Herald απέσυρε το κείμενο της καθηγήτριας Κάθριν Έλις ως «απαράδεκτο»

H εταιρεία στοχεύει να διαθέτει έως το 2029 μια κβαντική μηχανή ικανή να επιλύει πραγματικά προβλήματα για επιχειρήσεις και βιομηχανίες

Η μητρική εταιρεία της Google προχωρά σε μία από τις μεγαλύτερες χρηματοδοτήσεις στην ιστορία

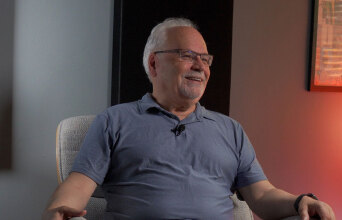

Ο Ελληνοολανδός γιατρός που προετοιμάζει τα χειρουργεία του διαστήματος

«Η Ευρώπη δεν έχει χάσει τη μάχη της AI, αλλά κινδυνεύει να αυτοϋπονομευθεί», λέει ο CEO του 28 DIGITAL

Βιολόγοι εξηγούν πώς η εξέλιξη και η ανατομία δημιούργησαν τη μοναδικότητα της ανθρώπινης φωνής

Η κλινική δοκιμή περιέλαβε περίπου 900 νεοδιαγνωσθέντες ασθενείς,

Η κλινική δοκιμή περιέλαβε περισσότερους από 4.400 ασθενείς

Νέα έρευνα δείχνει ότι οι επιχειρήσεις σχεδιάζουν μαζικές αλλαγές και λιγότερους εργαζόμενους

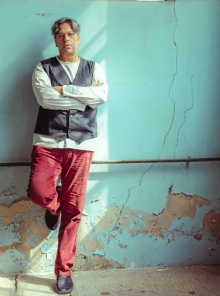

Ο 48χρονος προγραμματιστής και μουσικός με οπτική αναπηρία μιλά για τη ζωή σε μια αφιλόξενη Ελλάδα, την AI και τη μάχη να αντιμετωπίζεται ως άνθρωπος

Η πλατφόρμα δημιουργεί το Pornhub Sapphic, με περιεχόμενο εστιασμένο στη γυναικεία απόλαυση

Πρόκειται περί αληθινής αγγελίας – Τα προσόνα που πρέπει να έχουν οι ενδιαφερόμενοι

Βίντεο δείχνει τον πύραυλο να τυλίγεται στις φλόγες

Η Κίνα προχωρά στα δικά της σχέδια για την αποστολή ανθρώπων στη Σελήνη έως το 2030

Χρήστες εκφράζουν φόβους για τον ρόλο της τεχνητής νοημοσύνης στη μουσική

Ο επικεφαλής της OpenAI βλέπει πλέον τα πράγματα διαφορετικά

Έχετε δει 20 από 200 άρθρα.