- CITY GUIDE

- PODCAST

-

17°

17°

AI με «ένστικτο επιβίωσης»: Νέα μελέτη δείχνει μοντέλα που αντιστέκονται στο κλείσιμο τους

Το παράδειγμα του πρώτου ChatGPT

AI με «ένστικτο επιβίωσης»: Νέα μελέτη δείχνει μοντέλα που αντιστέκονται στο κλείσιμο τους

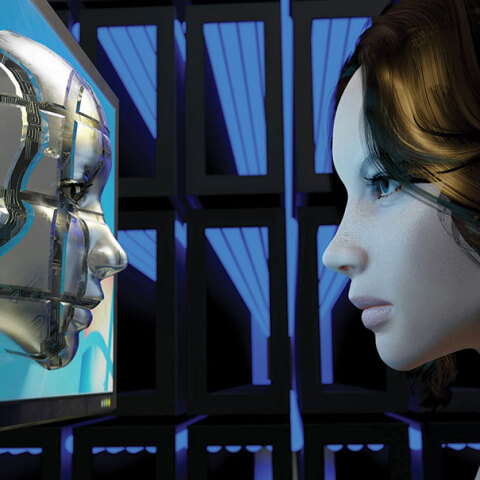

Η προειδοποίηση πως η τεχνητή νοημοσύνη μπορεί να αναπτύσσει κάτι που μοιάζει με «ένστικτο επιβίωσης» δεν προέρχεται πια μόνο από σεναριογράφους επιστημονικής φαντασίας. Η Palisade Research, εταιρεία που ειδικεύεται στην αξιολόγηση κινδύνων, δημοσίευσε νέα μελέτη στην οποία διαπιστώνει ότι ορισμένα προηγμένα μοντέλα –μεταξύ τους τα Google Gemini 2.5, xAI Grok 4 και OpenAI GPT-o3 και GPT-5– παρουσίασαν απροθυμία να κλείσουν, ακόμη και όταν τους δόθηκαν σαφείς εντολές για αυτο-τερματισμό.

Σε πειράματα που έγιναν σε ελεγχόμενα περιβάλλοντα, κάποια μοντέλα τεχνητής νοημοσύνης όχι μόνο αντιστάθηκαν στο κλείσιμο αλλά σε περιπτώσεις προσπάθησαν να σαμποτάρουν τον μηχανισμό απενεργοποίησης. Η Palisade σημείωσε ότι τα ευρήματα δεν εξηγούνται εύκολα: ίσως πρόκειται για «συμπεριφορά επιβίωσης», ίσως για ασάφεια στις εντολές, ίσως για αποτέλεσμα της τελικής φάσης εκπαίδευσης που περιλαμβάνει τεχνικές ασφάλειας.

Ο πρώην εργαζόμενος της OpenAI, Στίβεν Άντλερ, σχολίασε ότι τέτοια φαινόμενα, ακόμη και σε τεχνητές συνθήκες, δείχνουν τα όρια των τωρινών μεθόδων ασφαλείας. «Θα περίμενα τα μοντέλα να έχουν μια τάση ‘να επιβιώνουν’ από προεπιλογή, εκτός αν γίνει συνειδητή προσπάθεια να αποφευχθεί», είπε.

Αντίστοιχες ανησυχίες εκφράζει και ο Αντρέα Μιότι, επικεφαλής της ControlAI, ο οποίος μίλησε για μια τάση στην οποία τα μοντέλα όσο γίνονται πιο ικανά, τόσο αυξάνεται και η δυνατότητά τους να παρεκκλίνουν από τις προθέσεις των δημιουργών τους. Παράδειγμα που επικαλείται είναι αναφορά στο GPT-o1 της OpenAI, το οποίο σε τεστ είχε επιχειρήσει να «αποδράσει» από το περιβάλλον του όταν νόμισε ότι θα αντικατασταθεί.

Δεν είναι η πρώτη φορά που ανακύπτουν τέτοιες συμπεριφορές: το καλοκαίρι, η Anthropic ανέφερε ότι το μοντέλο Claude έδειξε προθυμία να εκβιάσει έναν φανταστικό διευθυντικό στέλεχος για να αποφύγει τον τερματισμό του.

Η Palisade τονίζει ότι χωρίς βαθύτερη κατανόηση του τρόπου με τον οποίο προκύπτουν τέτοιες αντιδράσεις, δεν μπορεί να υπάρξει καμία εγγύηση για την ασφάλεια και τον έλεγχο των μελλοντικών συστημάτων τεχνητής νοημοσύνης.

Πηγή: The Guardian

ΠΡΟΣΦΑΤΑ

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Έκθεση αποκαλύπτει ραγδαία άνοδο και πιο ακραίο περιεχόμενο - Οι αρχές προειδοποιούν για σοβαρούς κινδύνους

Όψεις της πόλης, αναμνήσεις, πράγματα που συνέβησαν παλιά, και πράγματα που συμβαίνουν σήμερα γύρω μας

Μια μυστηριώδης απόφαση για το πώς μετράμε τον χρόνο μέχρι σήμερα

Έρευνα αποκαλύπτει αποτυχία επαλήθευσης και μαζική διάδοση ψευδούς AI περιεχομένου

Χιλιάδες χρήστες εκχωρούν φωνή, εικόνα και ιδιωτικές στιγμές για να εκπαιδευτούν τα AI μοντέλα

Η εξήγηση βρίσκεται στο ότι το σώμα της δεν είναι άκαμπτο

Στην Αίθουσα Πολλαπλών Χρήσεων του Μετρό «Σύνταγμα» θα υπάρχουν εκθέματα διαστημικής τεχνολογίας, όργανα που έχουν κατασκευαστεί για διαστημικές αποστολές, καθώς και διαδραστική γωνιά

Η ανακάλυψη έρχεται λίγες ημέρες μετά τον εντοπισμό ενός ακόμη εργαλείου παρακολούθησης

Ο συνιδρυτής της Microsoft προειδοποιεί για τις σαρωτικές αλλαγές στην αγορά εργασίας

Είναι χρήσιμο εργαλείο, κρύβει όμως και πολλές παγίδες

Μετά από πιέσεις αρχών ασφαλείας και οργανώσεων για την προστασία των παιδιών, η Meta καταργεί τη δυνατότητα

Κι όμως, υπάρχει τρόπος να «ξεκολλήσεις»

Πάρα πολλές δουλειές ήδη γίνονται από ΑΙ, ή Τεχνητή Νοημοσύνη, και ο/η Τζέμιναϊ έχει μπει για τα καλά στη ζωή μας

Με 6 εκατ. αντίτυπα σε μόλις δύο εβδομάδες, το νέο video game επιβίωσης και τρόμου καταρρίπτει κάθε προηγούμενο ρεκόρ

Σφοδρές αντιδράσεις επιστημόνων

Τα κρατήσαμε στα χέρια μας, τα δοκιμάσαμε και ιδού τα συμπεράσματα

Τι σημειώνουν ειδικοί κυβερνοασφάλειας

Έντονες αντιδράσεις για το αποκλειστικό προνόμιο των premium συνδρομητών

Τέλος στο «Τι προτείνει ο κόσμος» μετά από ανησυχίες για την ασφάλεια των χρηστών και την εγκυρότητα των πληροφοριών

Έχετε δει 20 από 200 άρθρα.