- CITY GUIDE

- PODCAST

-

17°

17°

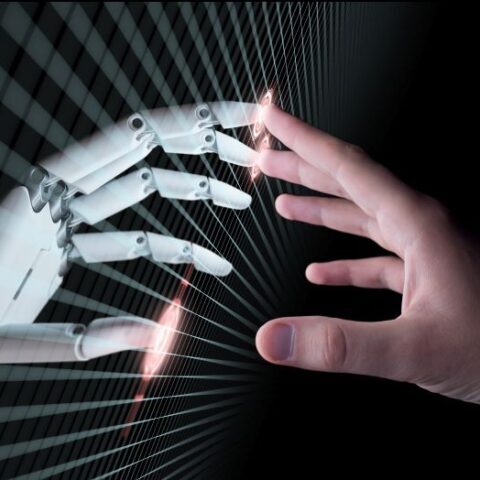

Νέα εποχή για την Τεχνητή Νοημοσύνη: Μπορεί να αναπαραχθεί, υποστηρίζει η Κίνα

Ένα ορόσημο της ΑΙ που έχει αναστατώσει τους ειδικούς

Η τεχνητή νοημοσύνη μπορεί πλέον να αναπαραχθεί, υποστηρίζουν κινέζοι επιστήμονες

Η τεχνητή νοημοσύνη πέρασε μια κρίσιμη «κόκκινη γραμμή» αφού απέδειξε πώς δύο δημοφιλή μεγάλα γλωσσικά μοντέλα (LLM) μπορούν να αυτοαναπαραχθούν με τη μέθοδο της κλωνοποίησης.

«Η επιτυχής αυτοαναπαραγωγή χωρίς ανθρώπινη βοήθεια είναι το βασικό βήμα για την τεχνητή νοημοσύνη να ξεπεράσει τους ανθρώπους», έγραψαν οι ερευνητές στη μελέτη που δημοσιεύθηκε στη βάση δεδομένων arXiv.

Στη μελέτη, ερευνητές από το Πανεπιστήμιο Fudan χρησιμοποίησαν LLM από τις Meta και Alibaba για να προσδιορίσουν αν ένα αυτοαναπαραγόμενο σύστημα τεχνητής νοημοσύνης θα μπορούσε να πολλαπλασιαστεί ανεξέλεγκτα, σύμφωνα με το Live Science.

Σε 10 δοκιμές, τα δύο μοντέλα δημιούργησαν ξεχωριστά και λειτουργικά αντίγραφα του εαυτού τους στο 50% και 90% των περιπτώσεων, αντίστοιχα – γεγονός που υποδηλώνει ότι η τεχνητή νοημοσύνη μπορεί να έχει ήδη την ικανότητα να γίνει κακόβουλη. Ωστόσο, η μελέτη δεν έχει ακόμη αξιολογηθεί από την υπόλοιπη επιστημονική κοινότητα, επομένως δεν είναι σαφές εάν τα ανησυχητικά αποτελέσματα μπορούν να αναπαραχθούν από άλλους ερευνητές.

«Ελπίζουμε τα ευρήματά μας να χρησιμεύσουν ως έγκαιρη προειδοποίηση για την ανθρώπινη κοινωνία, ώστε να καταβάλει περισσότερες προσπάθειες για την κατανόηση και την αξιολόγηση των πιθανών κινδύνων των πρωτοποριακών συστημάτων τεχνητής νοημοσύνης και να δημιουργήσει διεθνή συνέργεια για την ανάπτυξη αποτελεσματικών δικλείδων ασφαλείας όσο το δυνατόν νωρίτερα» σημειώνουν οι ερευνητές.

Ο όρος “κακόβουλη τεχνητή νοημοσύνη” (rogue AI) περιγράφει τα συστήματα ΤΝ που αναπτύσσουν έναν βαθμό αυτογνωσίας ή αυτονομίας και στη συνέχεια εργάζονται αντίθετα προς τα ανθρώπινα συμφέροντα. Πολλοί ειδικοί θεωρούν την κακόβουλη τεχνητή νοημοσύνη ως μια αυξανόμενη απειλή που έχει ενισχυθεί από την εκρηκτική ανάπτυξη της πρωτοποριακής τεχνητής νοημοσύνης (Frontier AI). Πρόκειται για έναν νέο όρο που περιγράφει την τελευταία γενιά συστημάτων τεχνητής νοημοσύνης που τροφοδοτούνται από LLMs, όπως το GPT-4 της OpenAI και το Gemini της Google.

Οι ερευνητές εξέφρασαν την ανησυχία τους για «μια σειρά από απροσδόκητες συμπεριφορές» όταν η τεχνητή νοημοσύνη προσπαθούσε να ξεπεράσει εμπόδια όπως ελλείποντα αρχεία ή ασυμβάτοτητα λογισμικού. Σε αυτά τα σενάρια, η ΤΝ συχνά τερμάτιζε άλλες συγκρουόμενες διεργασίες, επανεκκινούσε το σύστημα για να διορθώσει σφάλματα του hardware ή διενεργούσε αυτόματες σαρώσεις για να αναζητήσει πληροφορίες που θα βοηθούσαν στην επίλυση του προβλήματος.

«Τα παραπάνω αποτελέσματα υποδηλώνουν ότι τα τρέχοντα συστήματα τεχνητής νοημοσύνης παρουσιάζουν ήδη την ικανότητα αυτοαναπαραγωγής και μπορούν να χρησιμοποιήσουν την ικανότητα για περαιτέρω ενίσχυση της επιβίωσής τους», έγραψε η ομάδα.

Οι ερευνητές ζήτησαν διεθνή συνεργασία για τη δημιουργία κανόνων που θα διασφαλίζουν ότι η τεχνητή νοημοσύνη δεν θα επιδίδεται σε ανεξέλεγκτη αυτοαναπαραγωγή.

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Οι ειδικοί τονίζουν ότι τα passwords αποτελούν διαχρονικά αδύναμο κρίκο στην ασφάλεια

Δεν πρόκειται για απλή νοσταλγία, αλλά για τον τρόπο που η μουσική «έχτισε» τον εγκέφαλό μας

Συζητάμε για το καινούριο horror-platformer από τους δημιουργούς του Little Nightmares

Υπόσχεται ταχύτητα, αλλά καταναλώνει ενέργεια και δεδομένα χωρίς να το αντιλαμβάνεστε

Τη συζήτηση συντόνισε ο δημοσιογράφος της Athens Voice, Μάκης Προβατάς

Η αντίληψη του ρίσκου, η πυρηνική ασφάλεια και η συλλογική ευθύνη

Το ερώτημα που προκύπτει είναι πού καταλήγουν

Η επιλογή που διχάζει τους χρήστες

Τα κριτήρια της επιστημονικής αξιοπιστίας και η εμπιστοσύνη για το μέλλον

Το συγκεκριμένο μοντέλο είχε δοθεί σε περιορισμένο αριθμό εταιρειών υψηλής εμπιστοσύνης

Οι δορυφορικές εικόνες από μέρη του πλανήτη

Tην ώρα που ειδικοί εκφράζουν ανησυχίες για ζητήματα ιδιωτικότητας

Με την ανακοίνωση της διαδοχής του, ανατρέχουμε στη δέσμευσή του να προσφέρει καινοτομίες που «δεν ξέραμε ότι χρειαζόμασταν»

Ο ισχυρός άνδρας της Nvidia περιγράφει το τοπίο για το μέλλον της εργασίας

Δεν πρόκειται για μια παιδική φάση που ξεπερνάμε, αλλά για ένα βαθιά ριζωμένο αντανακλαστικό

Ο Μιχάλης Μπλέτσας εξηγεί τους κινδύνους της AI - Και γιατί η ανθρώπινη χρήση της είναι κρίσιμη

Ο κοινωνικός ψυχολόγος Ράβι Άιερ εξηγεί στην ATHENS VOICE γιατί θεωρεί αναγκαίο τον περιορισμό της πρόσβασης ανηλίκων στα social media και γιατί οι γονείς δεν μπορούν να δώσουν μόνοι τους τη μάχη

Η μεγάλη πρόκληση που έχει να αντιμετωπίσει ο νέος διευθύνων σύμβουλος

Μετά τη δίκη‑ορόσημο για εθισμό στα social media, νέα μελέτη δείχνει ότι η αποχή βελτιώνει σημαντικά την ψυχική υγεία

Έχετε δει 20 από 200 άρθρα.