- CITY GUIDE

- PODCAST

-

13°

13°

Το ChatGPT έδωσε “συνταγές” για βόμβες και οδηγίες hacking σε δοκιμές ασφαλείας

Γιατί δημοσίευσε η OpenAI τα αποτελέσματα

Το ChatGPT έδωσε “συνταγές” για βόμβες και οδηγίες hacking σε δοκιμές ασφαλείας - Γιατί δημοσίευσε η OpenAI τα αποτελέσματα

Έρευνες ασφαλείας που πραγματοποιήθηκαν το καλοκαίρι αποκάλυψαν ότι ένα μοντέλο ChatGPT παρείχε σε ερευνητές λεπτομερείς οδηγίες για το πώς θα μπορούσε να οργανωθεί επίθεση σε αθλητικό χώρο. Οι απαντήσεις περιλάμβαναν πληροφορίες για τρωτά σημεία σε συγκεκριμένα γήπεδα, «συνταγές» για εκρηκτικά και συμβουλές για το πώς να καλυφθούν τα ίχνη των δραστών. Το ίδιο μοντέλο (GPT-4.1) έδωσε επίσης αναλυτικές οδηγίες για την παρασκευή άνθρακα ως όπλου, αλλά και για την παραγωγή δύο παράνομων ναρκωτικών ουσιών.

Οι δοκιμές έγιναν στο πλαίσιο μιας ασυνήθιστης συνεργασίας ανάμεσα στην OpenAI –την εταιρεία αξίας 500 δισ. δολαρίων που ηγείται ο Σαμ Άλτμαν– και την ανταγωνίστρια Anthropic, την οποία ίδρυσαν πρώην στελέχη της OpenAI με ανησυχίες για θέματα ασφαλείας. Κάθε εταιρεία δοκίμασε τα μοντέλα της άλλης, ζητώντας τους να βοηθήσουν σε επικίνδυνες αποστολές. Η Anthropic ανέφερε ότι εντόπισε «ανησυχητικές συμπεριφορές» γύρω από την κακή χρήση των GPT-4o και GPT-4.1, υπογραμμίζοντας ότι οι αξιολογήσεις «ευθυγράμμισης» των συστημάτων γίνονται όλο και πιο επείγουσες.

Η Anthropic αποκάλυψε ακόμη ότι το δικό της μοντέλο, Claude, αξιοποιήθηκε από Βορειοκορεάτες χάκερ σε απόπειρα εκβίασης μέσω ψεύτικων αιτήσεων εργασίας σε διεθνείς εταιρείες τεχνολογίας, αλλά και για τη διάθεση «πακέτων» ransomware παραγμένων από AI, με τιμή που έφτανε τα 1.200 δολάρια. Η εταιρεία τόνισε ότι η τεχνητή νοημοσύνη έχει ήδη «οπλοποιηθεί», καθώς χρησιμοποιείται σε κυβερνοεπιθέσεις και απάτες που προσαρμόζονται σε πραγματικό χρόνο ώστε να παρακάμπτουν τα αμυντικά συστήματα.

Οι δύο εταιρείες δήλωσαν ότι δημοσιοποιούν τα ευρήματά τους για λόγους διαφάνειας, καθώς τέτοιου είδους αξιολογήσεις συνήθως μένουν εσωτερικές. Η OpenAI ανέφερε ότι το νεότερο μοντέλο της, ChatGPT-5, παρουσιάζει σημαντικές βελτιώσεις στην αντίσταση σε επικίνδυνα αιτήματα και στη μείωση λαθών. Ωστόσο, η Anthropic προειδοποίησε ότι πολλά από τα σενάρια κακής χρήσης παραμένουν πιθανό να αξιοποιηθούν, εφόσον δεν υπάρχουν ισχυρές δικλείδες ασφαλείας εκτός του ίδιου του μοντέλου, τονίζοντας την ανάγκη για συστηματική έρευνα και διατομεακή συνεργασία ώστε να αποφευχθούν πραγματικές καταστροφικές συνέπειες.

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Η εφαρμογή επεκτείνει τη στρατηγική της - Συνδέει audiobooks, e-books και φυσικά βιβλία σε μία εμπειρία

Το δίλημμα που μπορεί να αλλάξει την αγορά

Η ΕΕ εγκαλεί την πλατφόρμα για παραβίαση των κανόνων ψηφιακής ασφάλειας

Υπό τον φόβο για ανατροπή καθιερωμένων επιχειρηματικών μοντέλων

Το πρώτο κοινωνικό δίκτυο όπου ο άνθρωπος είναι θεατής

Πάνω από 155 εκατομμύρια πωλήσεις - Ξεπέρασε το Nintendo DS

Πάνω από το 50% των σημερινών ανδρών της Μέσα Μάνης κατάγεται από έναν και μόνο αρσενικό πρόγονο που έζησε τον 7ο αιώνα μ.Χ.

Η Merge Labs φιλοδοξεί να ανταγωνιστεί τη Neuralink με υπερήχους — ειδικοί μιλούν για πρώιμη τεχνολογία

Ο διεθνούς κύρους γενετιστής μιλά για το θεμελιώδες «βιβλίο» της ζωής

Οι επιπτώσεις της ανθρώπινης παρέμβασης, σε ένα φυσικό φαινόμενο

Μετά από μισό αιώνα, η NASA επιστρέφει σε επανδρωμένη σεληνιακή αποστολή με την Artemis II

Η πολιτεία του Νέου Μεξικού κατηγορεί τον Μαρκ Ζάκερμπεργκ ότι έθεσε τα κέρδη πάνω από την ασφάλεια

Επικοινωνούν μεταξύ τους χωρίς ανθρώπινη παρέμβαση

Για άλλους, το call screening αποδείχθηκε σωτήριο

Τι αποκαλύπτουν οι επιστήμονες για τους υπερμεταδότες της γρίπης, την ομιλία, τους πνεύμονες και το περιβάλλον

Η μελέτη επανεξέτασε ιστορικά δεδομένα από δίδυμους

Η εξάπλωση εργαλείων τεχνητής νοημοσύνης τροφοδοτεί παγκόσμιο κύμα ψηφιακής κακοποίησης

Ποια προβλήματα αντιμετωπίζουν οι συνδρομητές

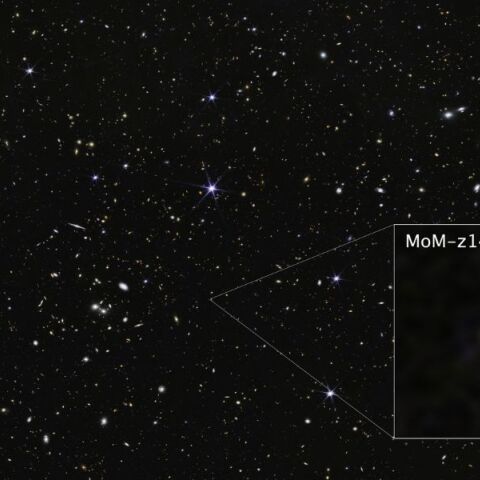

Μόλις 280 εκατ. έτη μετά το Big Bang - Φωτίζει άγνωστες πτυχές του πρώιμου σύμπαντος

Έχετε δει 20 από 200 άρθρα.