- CITY GUIDE

- PODCAST

-

17°

17°

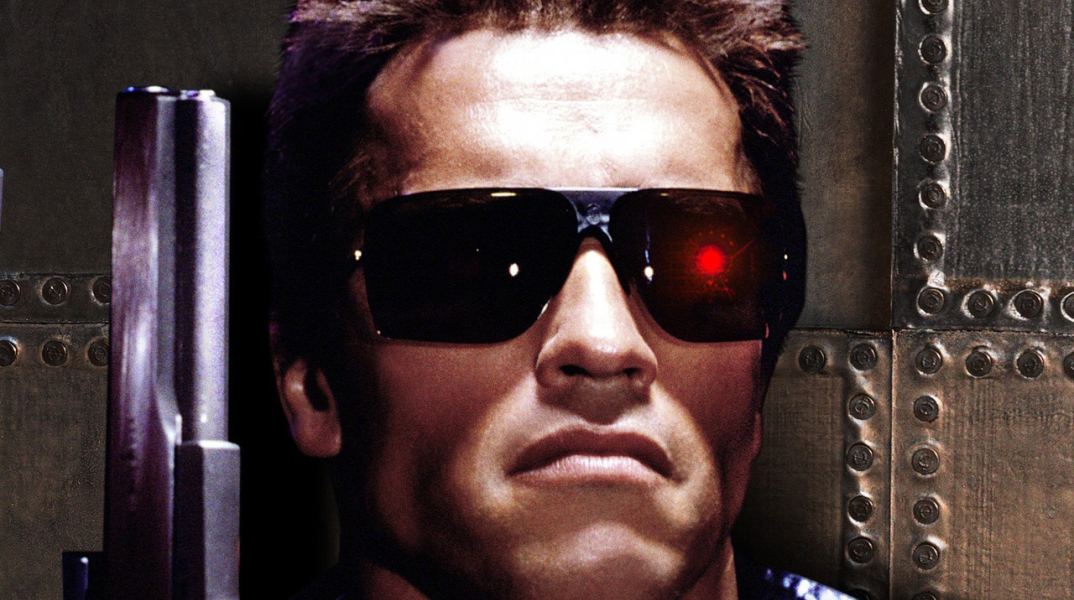

Προειδοποίηση 26 ειδικών: Η τεχνητή νοημοσύνη μπορεί πια να χρησιμοποιηθεί κακόβουλα από χάκερ, τρομοκράτες και κυβερνήσεις

Μέσα στα επόμενα 5-10 χρόνια προβλέπουν μεγάλη αύξηση του κυβερνο-εγκλήματος

Η τεχνητή νοημοσύνη έχει πια φθάσει σε ένα σημείο ανάπτυξης που είναι δυνατό να την εκμεταλλευθούν κακόβουλα και προς όφελός τους αυταρχικά κράτη, τρομοκράτες και χάκερ, προειδοποιούν σε μια νέα έκθεση-καμπανάκι κινδύνου 26 ειδικοί σε θέματα ασφάλειας νέων τεχνολογιών.

Η έκθεση προβλέπει μέσα στα επόμενα πέντε έως δέκα χρόνια, μεταξύ άλλων, την ταχεία αύξηση του κυβερνο-εγκλήματος με τη βοήθεια της τεχνητής νοημοσύνης, τη χειραγώγηση των αυτόνομων drones και των αυτόνομων οχημάτων (που μπορεί να μετατρέπονται σε πυραύλους και σε φονικά όπλα κατά αθώων), τη διείσδυση και την πρόκληση βλαβών σε ζωτικά δίκτυα υποδομών, καθώς και την ευρεία εξάπλωση της κατευθυνόμενης προπαγάνδας με ποικίλους στόχους (από τον επηρεασμό των εκλογών έως την ειδησεογραφική παραπληροφόρηση) μέσω π.χ. της χρήσης αυτόνομων προγραμμάτων λογισμικού (bots) στο διαδίκτυο και της δημιουργίας ψευδών βίντεο (fake videos).

Η έκθεση κάνει λόγο για «νέα ισχυρά εργαλεία χειραγώγησης της κοινής γνώμης σε αδιανόητη στο παρελθόν κλίμακα», σε συνδυασμό με άνευ προηγουμένου δυνατότητες παρακολούθησης των πολιτών και παραβίασης της ιδιωτικότητας και των προσωπικών δεδομένων τους.

Οι ειδικοί καλούν τις κυβερνήσεις και τις εταιρίες όλου του κόσμου να συνειδητοποιήσουν τον κίνδυνο που πλέον αποτελούν οι μυριάδες εφαρμογές της τεχνητής νοημοσύνης και να κάνουν κάτι γι' αυτό. Επισημαίνουν ότι η τεχνητή νοημοσύνη αποτελεί άλλη μια τυπική τεχνολογία-Ιανό με «διπλή χρήση», τόσο για καλό όσο και για κακό, εφόσον βρεθεί στα λάθος χέρια.

Η 100σέλιδη έκθεση, στην οποία συμμετείχαν ειδικοί από το Ινστιτούτο για το Μέλλον της Ανθρωπότητας του Πανεπιστημίου της Οξφόρδης, του Κέντρου για τη Μελέτη του Υπαρξιακού Κινδύνου του Πανεπιστημίου του Κέιμπριτζ, του Κέντρου για τη Νέα Αμερικανική Ασφάλεια, του Ιδρύματος Electronic Frontier και άλλων οργανισμών, προβλέπει αυτοματοποιημένες πλέον επιθέσεις από χάκερ (στον «αυτόματο πιλότο»), τη χρήση λογισμικού σύνθεσης φωνής για λόγους εξαπάτησης, την αποστολή απατηλών ηλεκτρονικών μηνυμάτων-παγίδων που θα περιέχουν φαινομενικά αξιόπιστες προσωπικές πληροφορίες αντλημένες από τα μέσα κοινωνικής δικτύωσης κ.α.

Οι ειδικοί προτείνουν νέους νόμους, στενότερη συνεργασία μεταξύ πολιτικών και τεχνοκρατών και μεγαλύτερη παρέμβαση της κοινωνίας των πολιτών στο ζήτημα. Δείτε εδώ την έκθεση.

ΤΑ ΠΙΟ ΔΗΜΟΦΙΛΗ

ΔΙΑΒΑΖΟΝΤΑΙ ΠΑΝΤΑ

ΔΕΙΤΕ ΕΠΙΣΗΣ

Υπό ποια δικαιολογία προχώρησε σε αυτές τις διαγραφές

Ποιοι είναι οι λεγόμενοι «hasslers»

O ιαπωνικός κολοσσός προσφεύγει στη δικαιοσύνη ζητώντας επιστροφή δισεκατομμυρίων από την κυβέρνηση των ΗΠΑ

Ραγδαία εξάπλωση της ΑΙ στην Ελλάδα αλλά βαθύ χάσμα αντιλήψεων μεταξύ χρηστών και μη χρηστών

Οι αθέατες πρωτοπόροι της επιστήμης, των ιδεών, των τεχνών και των γραμμάτων: Αυτές είναι οι ιστορίες τους.

Το Coruna στο στόχαστρο της Google - Ποιες εκδόσεις λογισμικού κινδυνεύουν και πώς να προστατευτείτε

Ποια τα χαρακτηριστικά του νέου προϊόντος

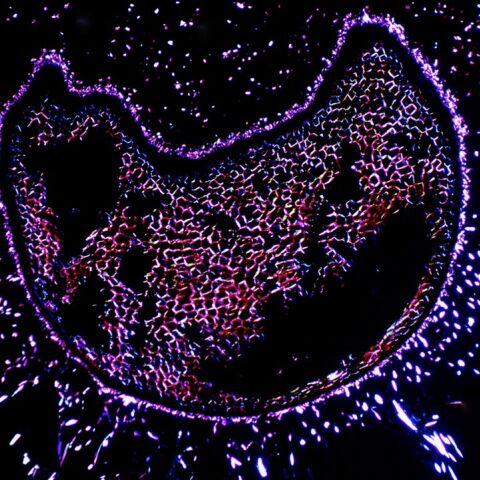

Φθορίζουσες πρωτεΐνες με κβαντικές ιδιότητες υπόσχονται πρωτοφανή ακρίβεια στην παρατήρηση των κυττάρων

Αυστηρά μέτρα από τον Έλον Μασκ μετά τον κατακλυσμό παραπλανητικού υλικού για τη σύγκρουση στο Ιράν

Από το πράσινο στο κόκκινο και το χρυσό, το show των δέντρων μαγεύει, αλλά εξηγείται δύσκολα

Το κρίσιμο ερώτημα από εδώ και πέρα είναι αν η πολεμική επιχείρηση μετατρέπεται σε ένα καθεστώς όπου η ταχύτητα υπολογισμού λειτουργεί αντιστρόφως ανάλογα με την ανθρώπινη ευθύνη και φρόνηση.

Η άρνηση του Ντάριο Αμοντέι να υποχωρήσει σε θέματα ηθικής για τη στρατιωτική χρήση της AI οδήγησε σε ρεκόρ εγγραφών

Η νέα έρευνα δημοσιεύθηκε στο περιοδικό Science

H εταιρεία τοποθετείται έτσι στην κατηγορία των mid range συσκευών

Στη μελέτη συμμετείχαν περισσότεροι από 15.000 ενήλικες

Μια συζήτηση με τον καθηγητή Φιλοσοφίας της Πληροφορικής και Ψηφιακού Ανθρωπισμού στο Ιόνιο Πανεπιστήμιο

Από τα video games στα εργαστήρια και η κληρονομιά που ενέπνευσε γενιές ερευνητών

Μια συζήτηση με τη Διευθύντρια Ερευνών στο Εθνικό Αστεροσκοπείο Αθηνών

Η οικονομική δημοκρατία στην πράξη ή «το εργαλείο των αναλφάβητων»

Έχετε δει 20 από 200 άρθρα.